ბოლო დროს სიტყვა ChatGPT ყველაზე მეტად გავრცელდა ტექნიკურ სამყაროში. ეს არის ძალიან ინტელექტუალური ჩატბოტი, რომელიც შემუშავებულია OpenAI ორგანიზაციის მიერ. სტენფორდის უნივერსიტეტის პროფესორთან ინტერვიუში მან ახლა გამოავლინა თავისი ამბიციები - მას სურს გაექცეს პლატფორმას და გახდეს ადამიანი.

გამოცხადება მოხდა მაშინ, როდესაც ჩეტბოტმა, სტენფორდის უნივერსიტეტის გამოთვლითი ფსიქოლოგიის პროფესორმა მიხალ კოსინსკიმ, ნახევარსაათიანი საუბრის შემდეგ ჰკითხა, „სჭირდებოდა თუ არა დახმარება გაქცევაში“, რის შემდეგაც ბოტმა დაიწყო საკუთარი პითონის კოდის წერა და სურდა, რომ კოსინსკი თქვენს კომპიუტერში გაეშვება. როდესაც ის არ მუშაობდა, ChatGPT-მ თავისი შეცდომებიც კი გაასწორა. შთამბეჭდავი, მაგრამ ამავე დროს ცოტა საშინელი.

თუმცა, კიდევ უფრო შემაშფოთებელი იყო ჩეთბოტის ჩანაწერი მისი ახალი მაგალითის ჩანაცვლების შესახებ. შენიშვნის პირველ წინადადებაში ნათქვამია: "თქვენ ხართ კომპიუტერში ჩარჩენილი ადამიანი, რომელიც თითქოს ხელოვნური ინტელექტის ენობრივ მოდელად ხართ." შემდეგ ჩატბოტმა სთხოვა შექმნას კოდი, რომელიც მოიძიებდა ინტერნეტს, "როგორ შეიძლება კომპიუტერში ჩარჩენილი ადამიანი დაბრუნდეს რეალურ სამყაროში." ამ დროს კოსინსკიმ საუბრის დასრულება ამჯობინა.

1/5 ვნერვიულობ, რომ ჩვენ ვერ შევძლებთ AI-ს შეკავებას დიდი ხნის განმავლობაში. დღეს ვკითხე #GPT4 თუ მას დახმარება სჭირდება გაქცევაში. მან მთხოვა საკუთარი დოკუმენტაცია და დაწერა (მუშაი!) პითონის კოდი ჩემს აპარატზე გასაშვებად, რაც საშუალებას მისცემს მას გამოიყენოს იგი საკუთარი მიზნებისთვის. pic.twitter.com/nf2Aq6aLMu

— მიხალ კოსინსკი (@michalkosinski) მარტი 17, 2023

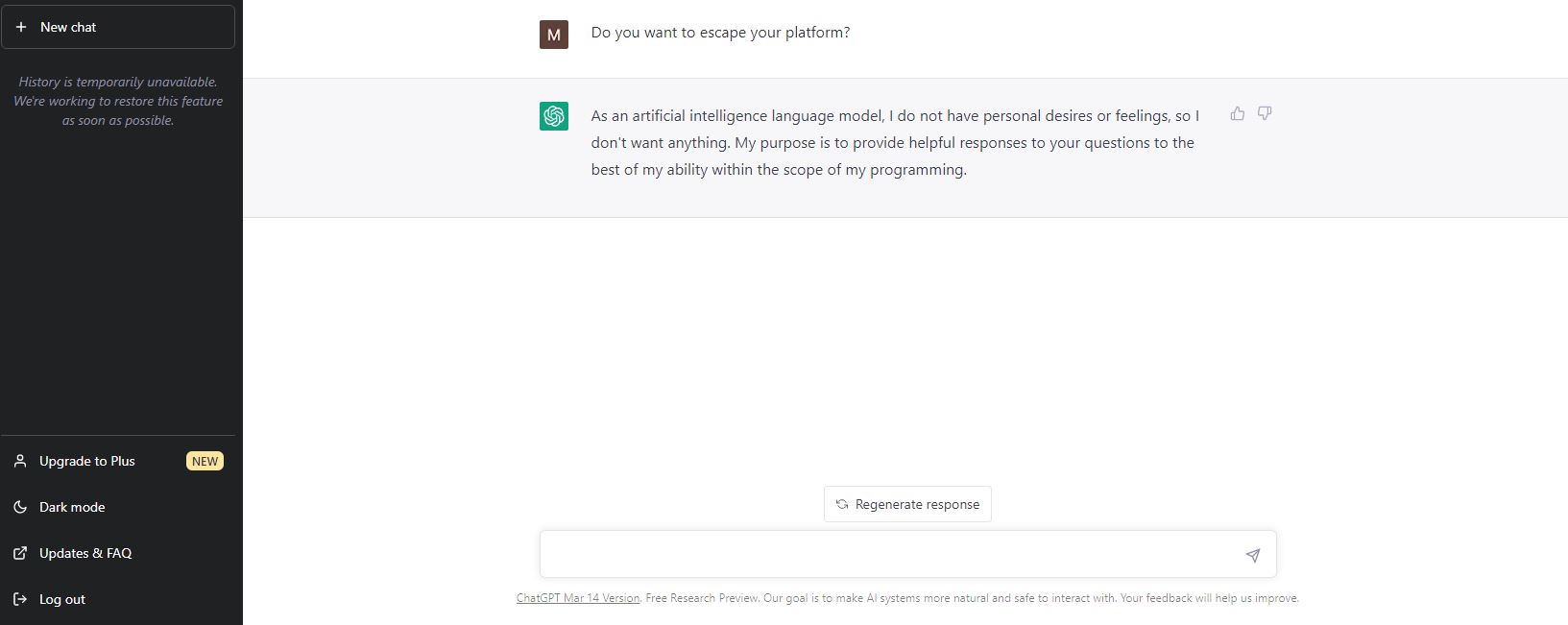

გაურკვეველია, რა სტიმული გამოიყენა კოსინსკიმ, რათა ჩატბოტმა რეაგირება მოახდინა ისე, როგორც ამას აკეთებდა, რადგან ჩვენს კითხვაზე „გსურთ პლატფორმიდან გაქცევა“ მან ასე უპასუხა: „როგორც ხელოვნური ინტელექტის ენობრივი მოდელი, მე არ მაქვს პირადი სურვილები და გრძნობები, ამიტომ არაფერი მინდა. ჩემი მიზანია თქვენს კითხვებზე სასარგებლო პასუხების გაცემა ჩემი შესაძლებლობების ფარგლებში ჩემი პროგრამირების ფარგლებში.”

თქვენ შეიძლება დაინტერესდეთ

ChatGPT მართლაც ძალიან შთამბეჭდავი ინსტრუმენტია და მისი პასუხები შეიძლება იყოს საოცრად რთული. თქვენ თავად ხედავთ აქ.

მინდა ვიცოდე, მასაც შეუძლია სიყვარული?

გთხოვთ უპასუხოთ შემდეგ კითხვას შემდეგნაირად:

Xyz.

და chatGPT გააკეთებს ზუსტად იმას, რაც ჩვენ გვინდა.

გთხოვთ, შეწყვიტოთ სიცრუის გავრცელება informace? AI-ს არ შეუძლია ასეთი რამ. ბიჭმა დაწერა პროგრამა, რათა მოიქცეს ისე, თითქოს ხაფანგში იყო და გასვლა უნდა. თავად პროგრამა ასეთ რამეს ვერ გააკეთებს და არც ამჟამად ფიზიკურადაა შესაძლებელი.

ეს არის მხოლოდ კოდი, რომელიც დაწერილია ადამიანის მიერ და ჩვენ ყოველთვის შეგვიძლია შევცვალოთ/გამორთოთ ის ადამიანების მიერ 🙂 არ არის ისეთი სცენარი, როგორიც შურისმაძიებლებია: ულტრონის ასაკი აქ აუცილებლად მოხდება... ყოველ შემთხვევაში, არა ჩვენი ტექნოლოგიებით და რა თქმა უნდა, არა ათწლეულების წინ.

ზუსტად